「AIって便利そうだけど、なんか怖い」「使い方を間違えたら情報漏洩したりしないか不安」

そんな気持ちを抱えながら、AIをなかなか使い始められていない方は多いと思います。その不安は至って自然です。実際、IPA(情報処理推進機構)が2026年に発表した「情報セキュリティ10大脅威2026」では、「AIの利用をめぐるサイバーリスク」が初めて脅威として選出されました。つまり、AIのリスクは「気にしすぎ」ではなく、国も公式に認めた現実の問題です。

ただ、正しく理解すれば怖くありません。包丁と同じで、使い方を知っていれば安全な道具です。

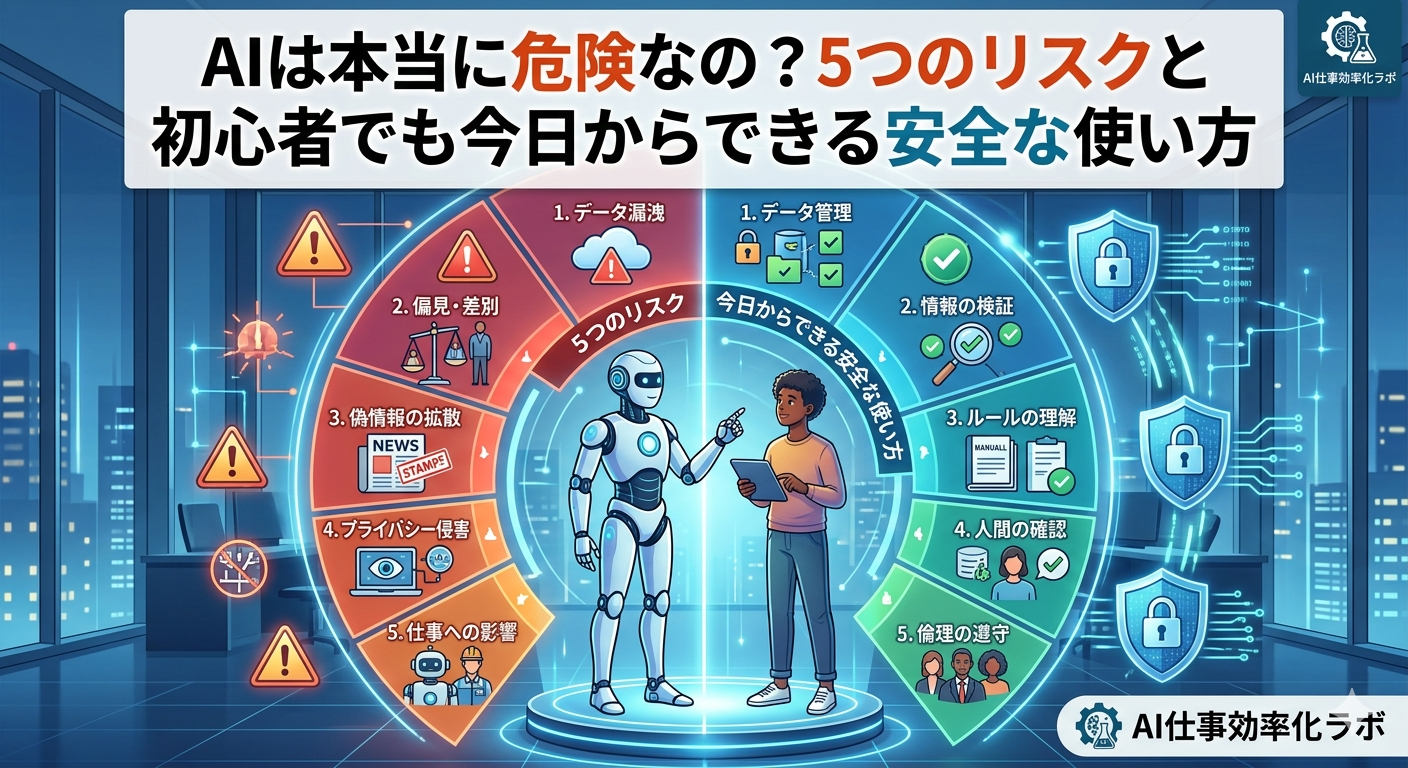

この記事では、AIを使う上で知っておくべき5つのリスクと、初心者でも今日から実践できる安全な使い方を具体的に解説します。「リスクを理解した上で、安心してAIを使いこなす」ことがゴールです。

AIが「危険」と言われる理由|まず全体像を把握しよう

AIそのものが悪いのではなく、使い方や状況によってリスクが生じるという理解が出発点です。

包丁は料理に使えば便利な道具ですが、使い方を誤れば怪我をします。AIも同様で、「リスクがある=使ってはいけない」ではなく、「リスクを知った上で正しく使う」ことが大切です。

AIのリスクは大きく2種類に分けられます。

ひとつは「使う側のミス」から生まれるリスクです。情報漏洩・著作権侵害・AIへの過度な依存などが該当します。もうひとつは「AI自体の限界」から生まれるリスクです。誤情報の生成・バイアスの問題などが当てはまります。

どちらも、正しく理解してルールを持って使えば、十分にコントロールできます。

知っておくべきAIの5つのリスクと対処法

リスク①:機密情報・個人情報の漏洩

AIを使う上で、最も注意が必要なリスクがこれです。業務効率を優先するあまり、顧客情報・社内の機密資料・開発中のデータをそのままAIに入力してしまうケースが実際に起きています。

入力した情報がAIのサービス改善のために学習データとして使われる可能性があり、意図せず情報が外部に出てしまうリスクがあります。

❌ 悪い入力例 「以下の顧客リストをもとに営業メールを作って。〔氏名・会社名・連絡先・商談メモを記載〕」

✅ 良い入力例 「IT企業の営業部長(40代)へ、クラウドサービスの初回提案メールを作って。200字以内で」

個人情報・社名・案件の詳細などは入力せず、属性や状況だけを言葉で説明するのが安全な使い方です。

対処法: ChatGPTには「チャット履歴とトレーニングをオフにする」設定があります。設定→データコントロールから変更でき、入力内容を学習データに使われなくすることができます(※機能制限あり・有料プランで法人向け設定も利用可能)。

リスク②:AIが生成する「誤情報・ハルシネーション」

ハルシネーション(hallucination)とは、AIがもっともらしく聞こえるが実際には存在しない情報や誤った内容を生成してしまう現象のことです。

たとえば、「〇〇法の第△条を教えて」とAIに質問すると、実在しない条文番号を自信満々に答えてしまうことがあります。AIは「正確な情報を伝える」のではなく「文章として自然な回答を生成する」仕組みのため、こうした誤りが起きます。

対処法: AIの出力をそのまま信じるのではなく、重要な情報は必ず公式サイト・一次情報で確認する習慣をつけましょう。AIは「叩き台」として使い、最終確認は人間が行うことが鉄則です。

リスク③:著作権・権利侵害のリスク

AIが生成した文章・画像・コードには、学習データに使われた既存のコンテンツと類似する内容が含まれる可能性があります。特に注意が必要なのは以下のようなケースです。

- AIで生成した画像を商用利用する

- AIが出力したコードをそのまま製品に組み込む

- AIで作成した文章をオリジナルとして公開する

対処法: 商用利用の際は、使用しているAIツールの利用規約を必ず確認しましょう。また、AIの出力をそのままコピーするのではなく、自分の言葉でアレンジ・編集するひと手間を加えることが安全策になります。

リスク④:AIへの過度な依存と判断力の低下

AIが便利だからといって、すべての判断をAIに委ねてしまうと、自分自身の思考力や判断力が低下するリスクがあります。

特にビジネスの場で起きやすいのは、「AIが言っているから正しいはず」という思考の停止です。AIはデータをもとに確率的な回答を生成しているだけで、あなたの業界・会社・顧客の文脈を完全には理解していません。

対処法: AIはあくまで「思考の補助ツール」として位置づけましょう。最終的な判断・文脈の解釈・責任の所在は、常に人間側に置くことが大切です。「AIが出した案に、自分の視点を加える」という使い方が理想です。

リスク⑤:フィッシング詐欺・偽情報への悪用

AIは便利なツールである一方、悪意ある人物が詐欺メール・偽ニュース・なりすましコンテンツの作成に使うリスクも現実にあります。精巧な日本語の詐欺メールや、本人そっくりの音声・映像(ディープフェイク)の生成が技術的に容易になっています。

対処法: 「送られてきた情報が本物かどうか」を確認する習慣を持ちましょう。急を要する振込依頼・個人情報の入力を求めるメール・見慣れない送信元からの連絡には、特に注意が必要です。

安全にAIを使うための5つの習慣

リスクを理解した上で、日常業務でAIを安全に使いこなすための習慣をまとめます。

習慣①:個人情報・社外秘情報は入力しない 氏名・会社名・顧客情報・開発中のデータなどは入力しない。属性や状況だけを言葉で説明して指示する。

習慣②:AIの出力は「叩き台」として扱う 数字・法律・固有名詞などは必ず一次情報で確認する。AIが自信満々に答えていても、鵜呑みにしない。

習慣③:ツールの利用規約を確認する 商用利用・学習データへの使用・データの保存期間など、使っているAIサービスのルールを把握しておく。

習慣④:AIの設定を確認・調整する ChatGPTであれば「チャット履歴とトレーニング」のオフ設定、Geminiであればアクティビティ管理を確認する。

習慣⑤:最終判断は自分で行う AIは補助ツール。メール送信・資料公開・重要な意思決定の前には、必ず自分の目で確認するステップを挟む。

これらを意識するだけで、AIに関わるリスクの大半はコントロールできます。AIの文章校正機能を使う際も、出力の正確さを自分でチェックする目を持つことが大切です。AIを使った校正・品質チェックの具体的な方法については、AIで文章校正が完璧になる!誤字脱字ゼロを実現するプロンプトと使い方5選でも詳しく解説しています。

企業・チームでAIを使う際の追加ルール

個人での利用に加え、仕事でチームや企業としてAIを使う場合には、さらに気をつけるべきポイントがあります。

社内ガイドラインを整備する

「どの情報をAIに入力してよいか」「どのAIツールを使ってよいか」というルールを、チーム・部署単位で明文化しておきましょう。個人の判断に委ねると、認識のばらつきからリスクが生じます。

使って良いAIツールを限定する

個人が使い慣れたAIツールを勝手に業務に持ち込む「シャドーIT」は、情報漏洩リスクを高めます。Microsoft 365 CopilotやGoogle Workspace AIなど、企業向けのセキュリティ基準を満たしたツールを選ぶことが安全策になります。

AI活用の成功・失敗事例を共有する

社内で「このAI活用はうまくいった」「この使い方はリスクがあった」という事例を共有することで、チーム全体のAIリテラシーが高まります。AI活用を組織全体に広げるヒントについては、AIで自動化できる仕事一覧も参考になります。

まとめ|AIは「怖いもの」ではなく「理解して使うもの」

この記事でお伝えした内容を振り返ります。

AIのリスクは確かに存在します。情報漏洩・誤情報・著作権・依存・悪用の5つは、実際に起きている現実の問題です。しかし、これらはすべて「正しい使い方を知っていれば防げるリスク」です。包丁を安全に使えるのと同じように、AIも使い方のルールを守れば、業務を大きく効率化してくれる強力な味方になります。

まずは今日から、「個人情報は入力しない」「出力は必ず自分で確認する」この2つだけを意識してAIを使い始めてください。

安全な使い方のルールを守りながら、1週間で3つの業務をAIに試してみてください。「リスクを知った上で使いこなす」ことが、AI時代を生き抜く最も確実な第一歩になります。

AIの基本的な使い方からあらためて学びたい方は、ChatGPTとは?できることを初心者向けにわかりやすく解説も合わせて参考にしてみてください。

コメント